Alibaba Cloud, облачное подразделение китайской компании Alibaba, анонсировала выпуск обновлённой, крупномасштабной языковой модели Qwen2.5-Max. ИИ-модель основана на архитектуре Mixture-of-Experts (MoE) и обучена на более чем 20 триллионах токенов. Разработчики подчёркивают, что инструмент показал «значительный прогресс в интеллектуальных возможностях» и уже доступен для использования.

Новая версия модели отличается улучшенной производительностью и точностью, способна лучше справляться с задачами, требующими глубокого понимания контекста, таких как анализ текста, перевод и генерация контента. «Qwen2.5-Max демонстрирует значительный прогресс в обработке сложных запросов и предоставлении релевантных ответов», — пишет компания на страницах своего блога.

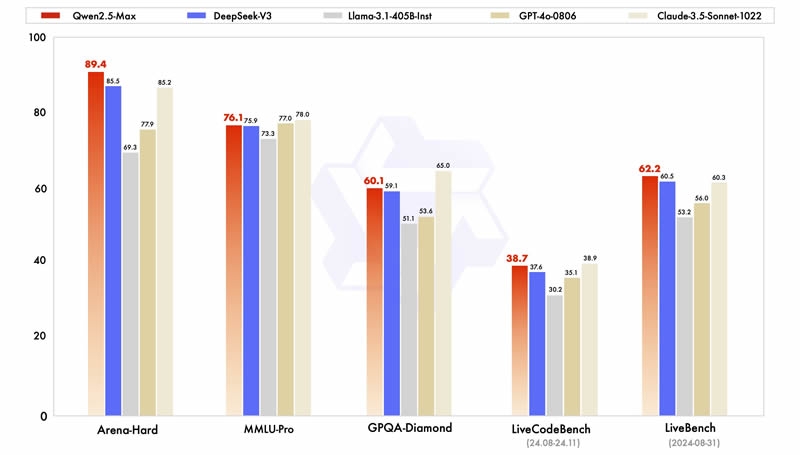

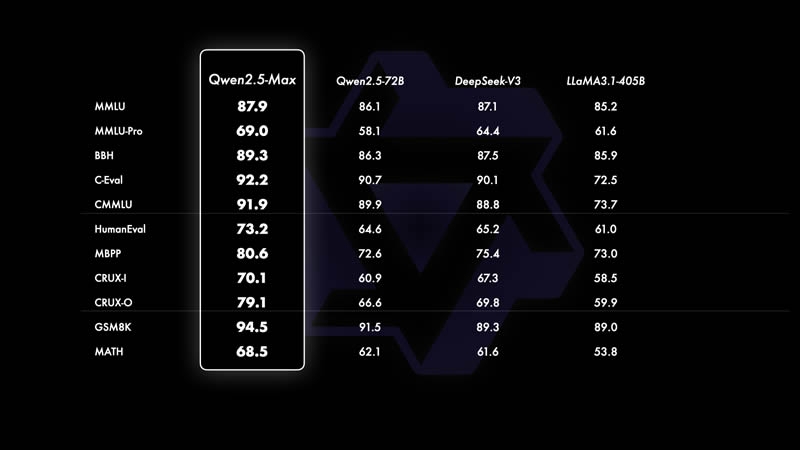

Qwen2.5-Max была протестирована в ряде ключевых бенчмарков, включая MMLU-Pro, LiveCodeBench, LiveBench и Arena-Hard. Модель показала превосходство над DeepSeek V3 в таких тестах, как Arena-Hard, LiveBench и LiveCodeBench, а также продемонстрировала конкурентоспособные результаты в MMLU-Pro. В сравнении с другими ведущими моделями, такими как GPT-4o и Claude-3.5-Sonnet, Qwen2.5-Max также подтвердила свои лидирующие позиции.

Alibaba Cloud планирует интегрировать Qwen2.5-Max в свои облачные сервисы, что позволит клиентам использовать инструмент для решения широкого спектра задач, включая автоматизацию обработки данных, улучшение взаимодействия с клиентами через чат-ботов и оптимизацию бизнес-процессов.

ИИ-модель уже доступна через сервис Qwen Chat, в котором пользователи могут взаимодействовать с Qwen2.5-Max, тестировать её возможности и экспериментировать с различными функциями. Для разработчиков также открыт программный интерфейс API. Для доступа необходимо зарегистрироваться в Alibaba Cloud, активировать сервис Model Studio и создать API-ключ.